问题描述

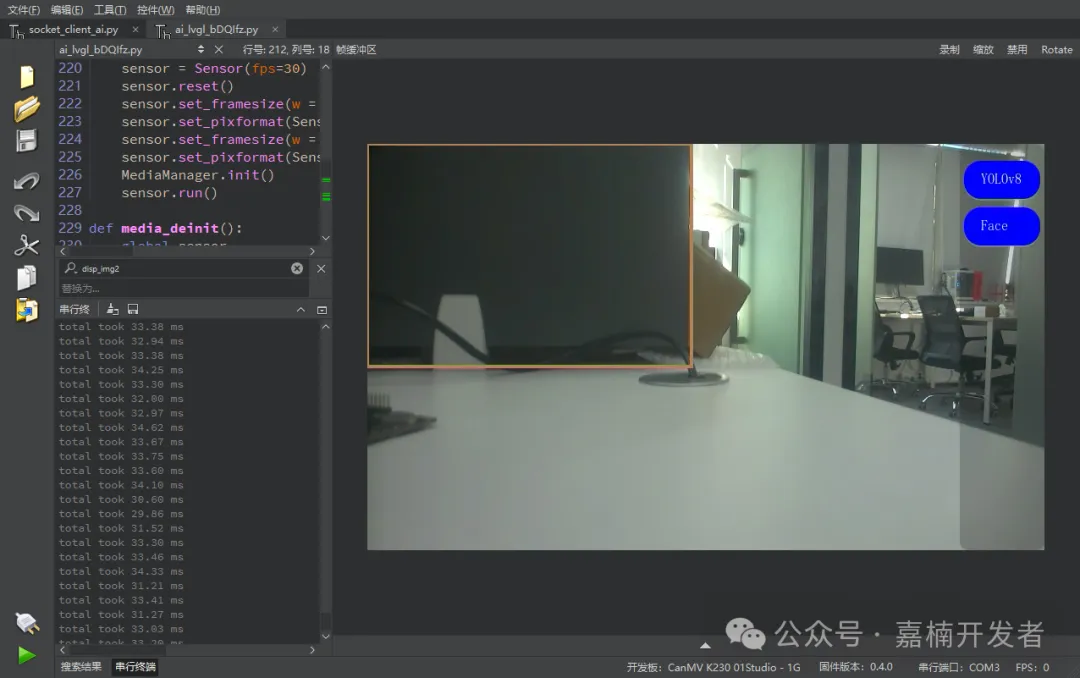

当嵌入式设备遇上AI视觉,再加上灵动的图形交互,会碰撞出怎样的火花?今天,我们要给大家带来一个基于K230的「LVGL+检测」 demo,带你解锁嵌入式智能交互的新姿势!

一、硬件环境

- K230开发板

- 摄像头

二、软件环境

-

K230最新底包

下载链接:

https://kendryte-download.canaan-creative.com/developer/releases/canmv_k230_micropython/daily_build/

demo路径:

\CanMV\sdcard\examples\21-AI-With-Others\ai_lvgl.py

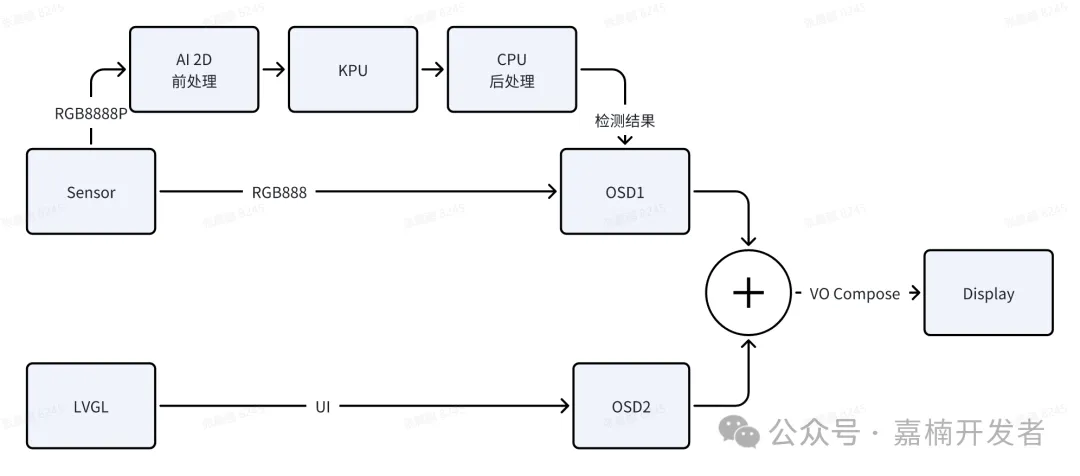

三、代码流程

1. AI模型封装

分别用ObjectDetectionApp和FaceDetectionApp类封装YOLOv8和人脸识别功能,包含预处理(图像缩放/填充)、推理、后处理(置信度过滤、NMS)和结果绘制,开箱即用

2. LVGL交互实现

通过touch_screen类处理触摸输入,user_gui_init函数初始化UI组件(按钮、字体、布局),点击事件直接关联检测模式切换,代码简洁易改。

3. 媒体与线程管理

media_init初始化摄像头和显示屏,face_det_thread和yolov8_det_thread作为独立线程运行检测和绘制结果动作。

4.适用场景拓展

这个demo只是起点,基于它你可以开发:

- 智能门禁:人脸识别+LVGL交互界面,支持刷卡/人脸双模式

- 零售货架:YOLOv8识别商品,LVGL显示价格和库存

- 宠物监控:识别宠物行为,触摸操作切换监控模式

行动起来!

如果你也想在K230上实现这样的智能交互,不妨从这个demo入手:

- 准备好K230开发板、摄像头和显示屏

- 加载demo代码,体验目标检测和人脸识别切换

- 动手修改UI样式,或者尝试接入自己训练的AI模型

嵌入式智能交互的更多可能,等你来解锁!